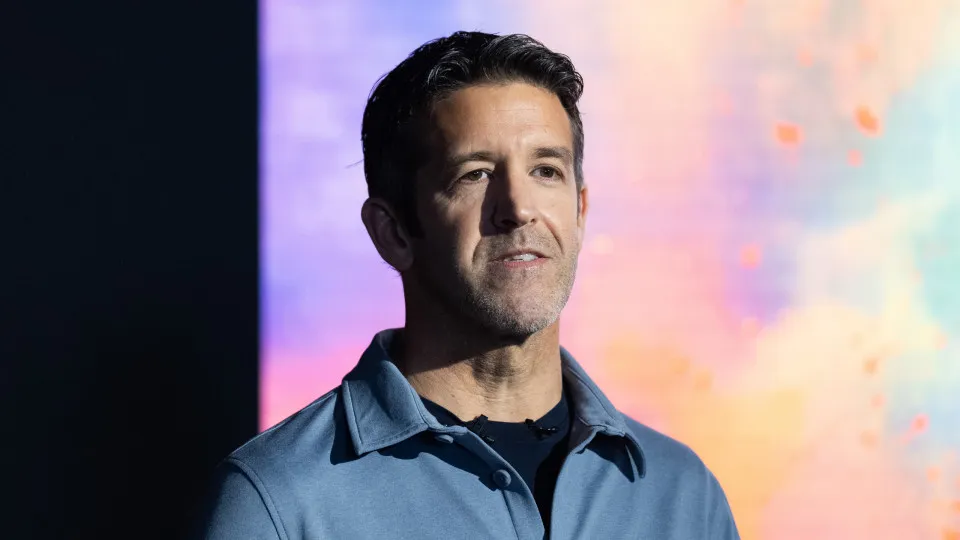

PELOTAS, RS (CBS NEWS) – A Apple anunciou nesta segunda-feira (20) que o executivo John Ternus será o próximo CEO da companhia. O veterano chefe de hardware irá conduzir a empresa enquanto a fabricante do iPhone se prepara para mudanças em todo o setor impulsionadas pela IA (inteligência artificial).

Ternus assumirá o cargo de CEO da Apple em 1º de setembro, sucedendo Tim Cook -que lidera a Apple desde 2011 e se tornará presidente executivo do conselho. Aos 50 anos, Ternus se tornará CEO com a mesma idade que Cook tinha quando assumiu o posto do cofundador Steve Jobs, em 2011.

Ele também passará a fazer parte do conselho de administração da empresa.

Ternus é natural do estado da Califórnia e entrou na equipe de design de produtos da Apple em 2001 e se tornou vice-presidente de engenharia de hardware em 2013. Ele passou a integrar a equipe executiva da empresa em 2021, quando assumiu seu cargo atual de vice-presidente sênior de engenharia de hardware, reportando-se a Cook.

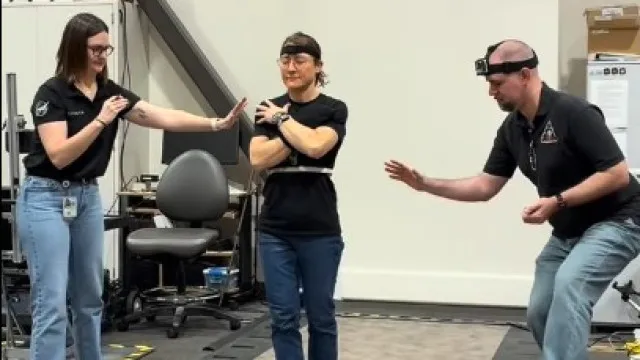

Antes da Apple, Ternus trabalhou como engenheiro mecânico na Virtual Research Systems. Ele se formou em engenharia mecânica pela Universidade da Pensilvânia, onde fez parte da equipe de natação. Para seu projeto de conclusão de curso, ele projetou um dispositivo que permitia a tetraplégicos usar movimentos da cabeça para controlar um braço mecânico de alimentação.

CUIDADOSO E DISCRETO

Ternus supervisionou algumas das apostas mais importantes da Apple em hardware nos últimos anos, incluindo as equipes responsáveis por iPhone, iPad, Mac, Apple Watch e AirPods.

Ele teve um papel fundamental na retomada das vendas de produtos como os computadores Mac da Apple, que ganharam participação de mercado nos últimos anos. Também apresentou mais recentemente o iPhone Air no ano passado, a maior reformulação do iPhone desde 2017.

Por volta de 2018, a Apple considerou adicionar um pequeno laser aos seus iPhones. O componente permitiria aos consumidores tirar fotos melhores, mapear seus arredores com mais precisão e usar novos recursos de realidade aumentada. Mas também custaria à Apple cerca de US$ 40 por aparelho, reduzindo os lucros da empresa.

Foi Ternus que sugeriu adicionar o componente apenas aos modelos mais caros do iPhone, disseram duas pessoas familiarizadas com as discussões ao New York Times. Esses dispositivos, argumentou Ternus à época, tendiam a ser comprados pelos clientes mais fiéis da Apple, que ficariam empolgados com a nova tecnologia. Os consumidores comuns, por outro lado, provavelmente não se importariam.

Encontrar o equilíbrio entre adicionar novos recursos aos produtos da Apple enquanto cuida do resultado financeiro tem definido o estilo cuidadoso e discreto de Ternus, conhecido por sua atenção aos detalhes e seu conhecimento da vasta rede de fornecedores da Apple –características que também definiram o estilo de gestão de Cook.

Ambos também são considerados colaboradores equilibrados, capazes de navegar pela burocracia de uma das empresas mais ricas do mundo sem criar atritos. “Se você quer fazer um iPhone todo ano, Ternus é o cara certo”, disse Cameron Rogers, que trabalhou em gestão de engenharia de produtos e software na Apple de 2005 a 2022.

TRAJETÓRIA NA APPLE

Ternus é o primeiro CEO da Apple em três décadas a ter passado sua carreira trabalhando com hardware. Diferentemente de alguns dos outros candidatos a substituir Cook, ele trabalhou em muitos dos dispositivos da Apple, bem como nas operações globais que fabricam esses produtos.

No entanto, ele assume como um relativo desconhecido fora da empresa. Internamente, ele é mais conhecido por manter produtos do que por desenvolver novos, de acordo com seis ex-funcionários. E Ternus, que foi engenheiro no Vale do Silício durante toda a sua vida adulta, tem exposição limitada às questões políticas e responsabilidades associadas ao cargo máximo da Apple.

Nos quatro anos após se formar em 1997, ele projetou headsets e outros produtos em uma startup de realidade virtual. Ele então entrou na Apple, trabalhando primeiro em telas para Macs enquanto a empresa fazia a transição dos coloridos iMacs do final dos anos 90.

Em cerca de três anos, se tornou gerente, disse Steve Siefert, o primeiro chefe de Ternus na Apple. Durante esse período, a equipe mudou de andar, passando de um escritório fechado para um layout majoritariamente aberto com alguns escritórios. Quando foi promovido, Ternus teve a opção de se mudar para um desses escritórios, mas recusou.

Ternus era “um homem do povo”, disse Siefert, acrescentando que a decisão de sentar com sua equipe provavelmente ajudou Ternus a gerenciar e motivar sua equipe. Quando Siefert se aposentou em 2011, liberando seu escritório, Ternus mais uma vez disse que queria permanecer no espaço aberto.

Em 2005, Ternus havia sido promovido para liderar a equipe de engenharia de hardware da Apple para iMacs enquanto ela desenvolvia a série G5, disse Michael D. Hillman, que ajudou a contratar Ternus e trabalhou com ele na Apple por mais de uma década.

Ternus passou longos períodos trabalhando com fabricantes na Ásia, disse Hillman. O executivo viajava entre o continente e o Vale do Silício e aprendeu como podia ser difícil fazer um fornecedor de manufatura entregar conforme as expectativas de design da Apple. A Apple também colocou Ternus com um consultor externo para aconselhá-lo sobre liderança.

Ternus se tornou um tenente-chave de Dan Riccio, seu antecessor como chefe de hardware da Apple. Em 2013, o papel de Ternus havia se expandido para incluir a supervisão das equipes de Mac e iPad.

Nos últimos anos, ele assumiu mais responsabilidade por atualizações nos produtos da Apple. Ele liderou o iPhone Air, lançado no ano passado com um novo design fino, e foi um líder-chave na transição da Apple do uso de chips da Intel em Macs para o uso dos próprios chips da empresa em 2020. Ternus também esteve envolvido nas experimentações da Apple com telefones dobráveis, de acordo com uma das pessoas próximas à empresa.

“A promoção de Ternus indica que a empresa vai focar em novos dispositivos de hardware, como celulares dobráveis, óculos, dispositivos de realidade virtual e AI pins”, disse Gil Luria, diretor-geral da D.A. Davidson & Co.